Replicator 2Xが届くのが待ちきれないので 、

英語の勉強を兼ねて2のマニュアル(PDF)を翻訳してみようかと

翻訳てきとーですがご容赦を(内容に間違いがあっても責任とりませんので自己責任で

Replicatorシリーズのその他の情報はこちら

Replicator 2Xが届くのが待ちきれないので 、

英語の勉強を兼ねて2のマニュアル(PDF)を翻訳してみようかと

翻訳てきとーですがご容赦を(内容に間違いがあっても責任とりませんので自己責任で

Replicatorシリーズのその他の情報はこちら

ミドルタワーのデスクトップPCを送ろうとしたら

思いの外、適したプランがないことが判明したのでメモ

P182とかのサイズを2台、神奈川→東京の場合です

ちなみに、パソコンポ他のPC専用サービスではサイズ的にNGでした

というわけで、自分で梱包するならゆうパック、面倒で高くても良いなら家財宅急便がベストかと

追記:結局2台を1つの段ボールに梱包して、ゆうパックで送ったところ

1700円で、19時集荷、翌9時着でした

損傷もなかったので文句なしです

あ、ファンは外しておいたほうがいいらしいですよ(テンションかかってるから

Windows Azure Advent Calendar 13日目です

卒論に追われつつインストールマニアックスに参加中ですが、

前から気になってた Media Services をポータルから遊べる範囲で遊んでみたので、

そのレビュー的な何かになります

ちなみに、Media Servicesは現時点ではプレビューの段階なので無料

(注:ストレージ等は課金されます)らしいです

「新規」→「アプリ サービス」→「メディア サービス」→「簡易作成」から

名前等を入力してメディアサービスの作成をクリックします

ストレージ アカウントはすぐ出来上がりますが、メディア サービスは若干時間がかかるみたいです

メディア サービスから作成したものをクリックしてダッシュボードを表示してみます

ストレージ、エンコーダー、オリジン(配信サーバー?)にリンクされているみたいです。

「コンテンツ」の「アップロード」から適当な動画をアップロードします

今回は Windows7 のサンプルビデオを使いました

アップロードが終わった(はず)なのですが、サイズが0Bで表示されています

念のためAzure Storage ExplorerでBlobの中を確認してみましたが

25MBと表示されているので問題なさそうですね

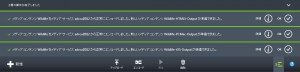

アップロードしたファイルを選択して、下部のメニューからエンコードを選択し

プリセットを選んでエンコードします

とりあえずプリセット3つ全てやってみます

待つこと約15分・・・

全部エンコードが終わりました

ちなみに、エンコードにかかった時間ですが大体

PC/Mac : 5分半

HTML5 : 3分

iOS : 7分

ぐらいでした

追記:こちらの動画(9分あたり)いわく、コンピュートは現状マルチテナントとのことです

なので、上記のエンコード速度はあくまでも参考程度でお願いします

iOS用のプリセットは中間ファイルとしてPC/Macのファイルも生成しているようで、

その分だけ時間がかかったようです

Azure Storage Explorerでエンコード後のBlobの中を見てみます

アセットごとにコンテナが作成されてるようですね

↑↓PC/Mac用とiOS用の中間ファイルは同じものみたいですね

↓iOS用はビットレートごとに複数エンコードされてる模様

↓HTML5はmp4とxmlだけみたい

エンコードが終了したら、メニューから発行をクリックして公開します

というわけで、発行されたものを以下に公開しておきます(数日で消します)

あと、Media Servicesの情報をあさってるときに見つけたC#のサンプルを載せておきます

Windows Azure Media Services Getting Started Sample

以上、Windows Azure Advent Calendar 13日目でした

SurfaceにPrintScreen(PtSc)キーがない件ですが、

OneNoteのキャプチャが一番シンプルで楽そう

過去にOneNote起動したことがあればWin+Sとかで起動

OneNoteに送るなりクリップボードにコピーするなりあとはご自由に

追記:

ディスプレイ中央のWindowsボタンと、ボリュームを下げるボタンの同時押しでスクリーンショットがピクチャの下に保存されるらしいことが分かりました

ストアアプリとかはこちらでないと無理そうです

ProcessingとSimpleOpenNIの環境構築については過去の記事を参照

depthMapとcameraを描画するサンプル(GoogleCodeより)

import SimpleOpenNI.*;

SimpleOpenNI context;

void setup()

{

context = new SimpleOpenNI(this);

// enable depthMap generation

context.enableDepth();

// enable camera image generation

context.enableRGB();

background(200,0,0);

size(context.depthWidth() + context.rgbWidth() + 10, context.rgbHeight());

}

void draw()

{

// update the cam

context.update();

// draw depthImageMap

image(context.depthImage(),0,0);

// draw camera

image(context.rgbImage(),context.depthWidth() + 10,0);

}

まずはおまじない

import SimpleOpenNI.*; SimpleOpenNI context;

と

context = new SimpleOpenNI(this);

デプスマップやカメラ画像の有効化

context.enableDepth(); context.enableRGB();

Kinectから取得する画像等の更新

context.update();

あとは

depthImage()

やら

context.rgbImage()

がPImageとして扱えるのでそのまま描画するだけ